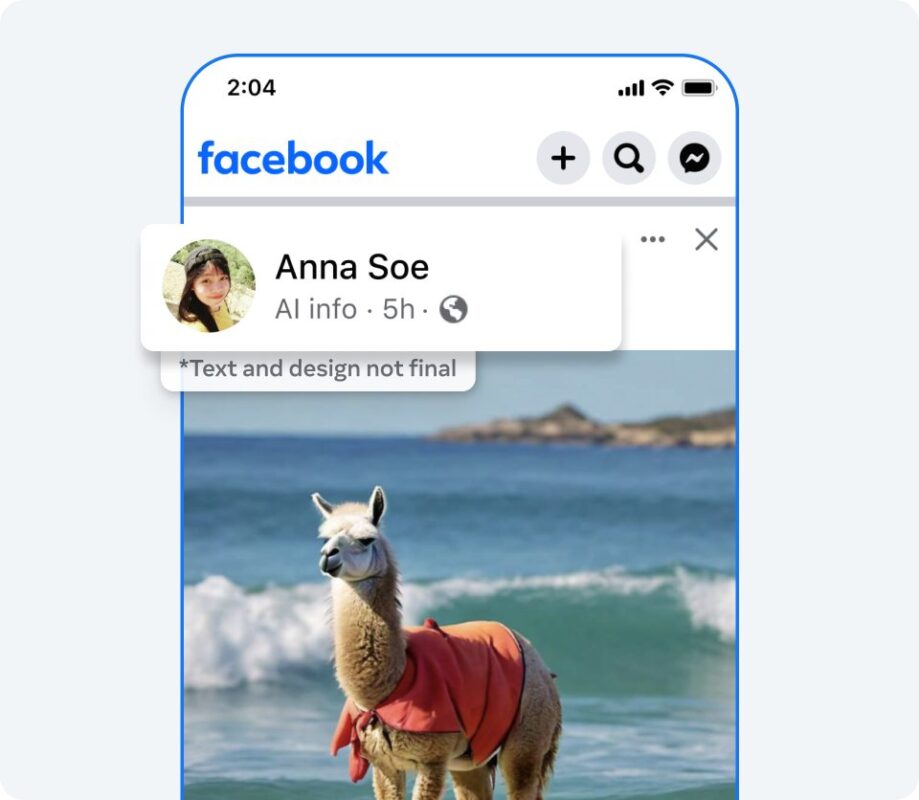

Com o aumento do uso da IA generativa, Meta está trabalhando para estabelecer novas normas em torno da divulgação da inteligência artificial em seus aplicativos. As novas políticas colocarão mais responsabilidade nos usuários ao declarar o uso da IA em seu conteúdo e estabelecem novos sistemas para detectar o uso da IA por meio de meios técnicos.

‘Estamos criando ferramentas líderes no setor capazes de identificar marcadores invisíveis em escala – especificamente, as informações ‘geradas por IA’ das normas técnicas C2PA e IPTC – para poder rotular imagens do Google, OpenAI, Microsoft, Adobe, Midjourney e Shutterstock à medida que implementam seus planos de adicionar metadados às imagens criadas por suas ferramentas’, diz Nick Clegg, presidente de assuntos globais do Meta, em um post de blog.

Em teoria, essas medidas técnicas de detecção permitirão ao Meta e outras plataformas etiquetar o conteúdo criado com IA generativa onde quer que apareça, a fim de que todos os usuários estejam melhor informados sobre o conteúdo criado por uma inteligência artificial.

Entre outras coisas, as novas medidas ajudarão a reduzir a disseminação de desinformação criada com IA (textos, imagens, vídeos ou áudios), o que poderia impedir (ou dificultar) que situações como a vivida pela cantora Taylor Swift voltem a se repetir.