Whisper, l’outil de transcription développé par OpenAI et basé sur l’intelligence artificielle, ment beaucoup. Trop. Selon plusieurs experts dans le domaine technologique, cet outil est enclin à « halluciner », c’est-à-dire à inventer des fragments de texte ou des phrases entières, ce qui peut avoir des conséquences désastreuses dans des secteurs comme celui de la santé.

Abonnez-vous à la newsletter de Softonic et recevez les dernières nouveautés en technologie, jeux vidéo et offres directement dans votre boîte

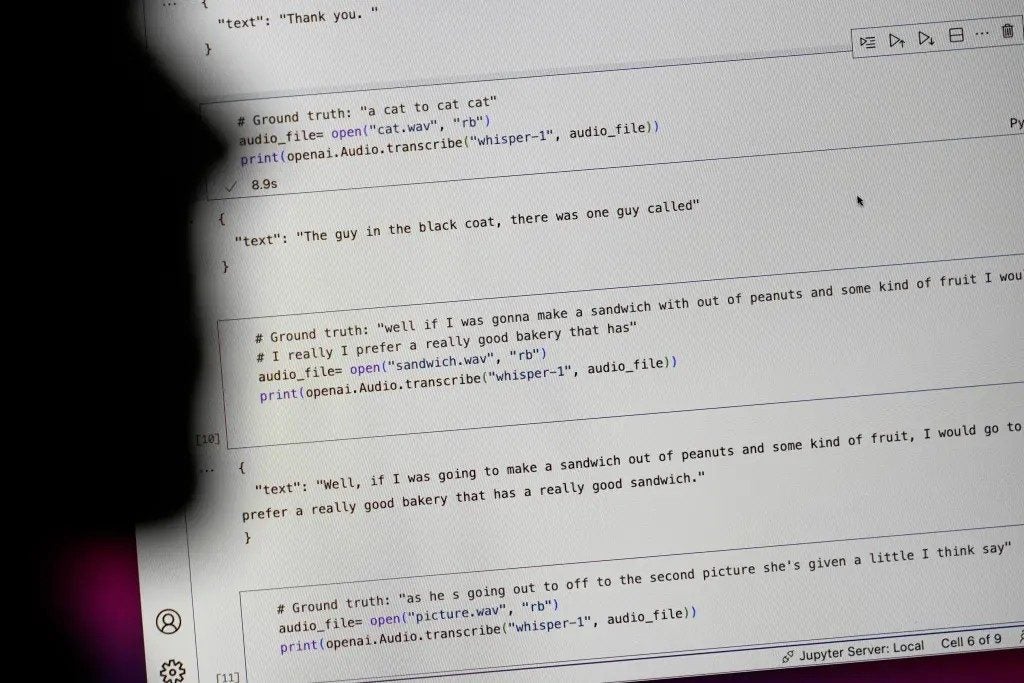

Abonnez-vous (c'est GRATUIT) ►Un groupe de chercheurs et de développeurs consulté par Associated Press a expliqué que Whisper, utilisée dans de nombreux domaines, a tendance à générer des transcriptions erronées qui incluent du contenu inventé et même des commentaires racistes.

Cela devient encore plus problématique lorsque son utilisation s’étend à des domaines à haut risque, comme la transcription de consultations médicales, où une erreur de précision pourrait affecter directement la santé des patients. « Personne ne veut un diagnostic erroné », a déclaré Alondra Nelson, ancienne directrice de l’Office de la politique scientifique et technologique de la Maison-Blanche, qui estime qu’une plus grande fiabilité devrait être exigée pour ce type de technologies.

L’ampleur du problème est considérable. Une étude récente a détecté 187 hallucinations dans plus de 13 000 fragments audio clairs, et dans une autre analyse, un chercheur de l’Université du Michigan a trouvé des hallucinations dans 8 transcriptions sur 10 inspectées. De plus, les erreurs ne se limitent pas aux fragments longs ou de mauvaise qualité ; elles se produisent également dans des audios courts et bien enregistrés. Un ingénieur spécialisé en apprentissage automatique a affirmé avoir trouvé des erreurs dans la moitié des 100 heures de transcriptions qu’il a analysées.

Ces défaillances ont poussé des experts et des défenseurs de l’utilisation éthique de l’intelligence artificielle à demander au gouvernement américain de réglementer l’utilisation de ces outils. Christian Vogler, un universitaire sourd de l’Université de Gallaudet, souligne que Whisper est également utilisé pour sous-titrer des vidéos pour les personnes sourdes, qui sont particulièrement vulnérables aux erreurs de transcription. Selon les experts, résoudre ces bugs devrait être une priorité pour OpenAI avant que Whisper ne soit intégré dans des systèmes et applications nécessitant une grande précision dans leur fonctionnement.