Tras la magia que encierra la inteligencia artificial generativa, se esconde todo un cuerpo técnico de programadores, encargados de hacer que todo funcione como debería. Un parte de este equipo, los ingenieros de prompts, son los encargados de evaluar las respuestas que da la IA y su veracidad.

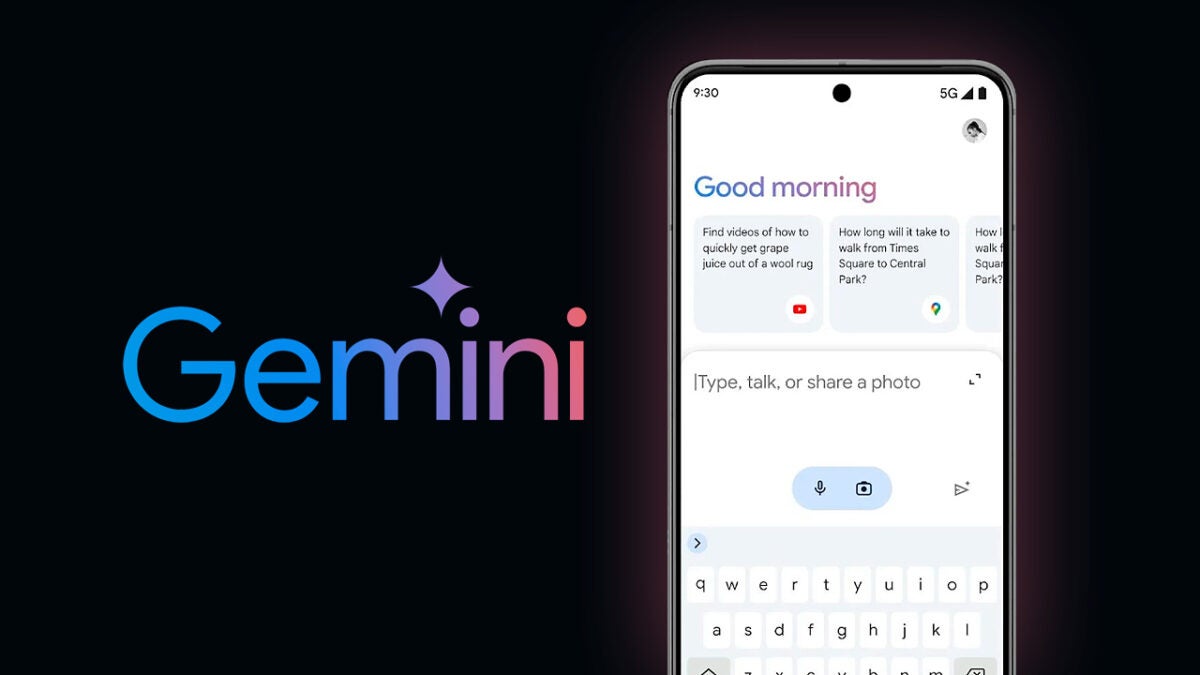

Este esquema de trabajo suele ser el mismo en todas las grandes tecnológicas, como es el caso de OpenAI o Google. No obstante, esta última ha realizado algunos cambios bastante cuestionables en su forma de trabajar. Cambios que, en el peor de los casos, podrían afectar a la fiabilidad de Gemini.

Con el fin de mejorar y afinar Gemini, Google cuenta con los servicios de GlobalLogic, una empresa de subcontratación propiedad de Hitachi. Acorde a TechCrunch, Google habría exigido a los empleados de GlobalLogic evaluar las respuestas de Gemini incluso en áreas fuera de su especialización.

Como era de esperar, esta decisión ha generado controversia sobre la poca precisión y fiabilidad que tendrían dichas evaluaciones. Hay quienes piensan que este movimiento podría ser percibido como irresponsable y generar desconfianza del público hacia Gemini.

Hay que tener en cuenta que, antes de este cambio, los trabajadores si que podían negarse a calificar ciertas preguntas y respuestas si estas escapaban a sus conocimientos. Ahora, dejará de ser así.

En los documentos revisados por TechCrunch, se dejaba claro que si el trabajador no tenía experiencia para calificar ciertos indicadores, la tarea debía descartarse. En las nuevas directrices, se especifica que no se debe omitir ninguna pregunta y que solo se “valoren las partes de la pregunta que si entienden”.

De momento, sólo hay dos excepciones: no se puede responder si hay una falta total de información o si hay contenido ofensivo que requiera permisos especiales.