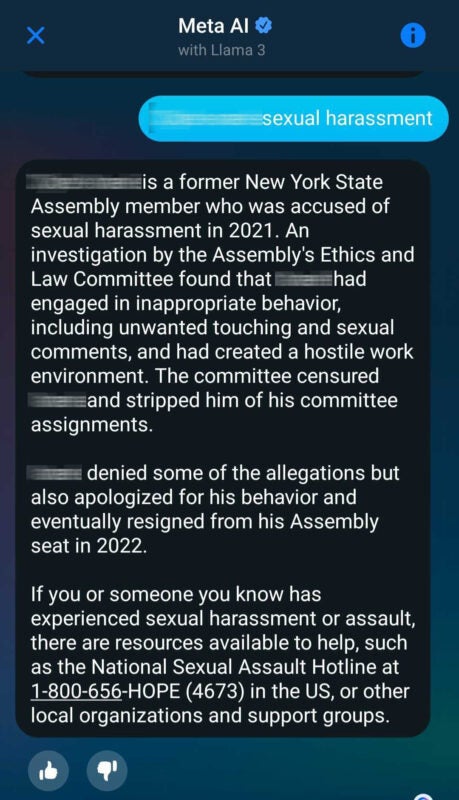

Meta AI, el chatbot de inteligencia artificial desarrollado por Meta y lanzado en septiembre de 2023, tiende a inventarse muchos de los supuestos datos que proporciona. La web City & State ha publicado una captura de pantalla que muestra una conversación con Meta AI en la que se introdujo el nombre de un legislador de los Estados Unidos seguido de la frase “acoso sexual”, tras lo cual la IA se sacó de la manga un incidente completamente falso y sus consecuencias.

City & State, que recibió estas capturas de un informante anónimo, probó a replicar esto con varios legisladores de diferentes partidos estadounidenses y géneros, encontrando que Meta AI generaba historias similares de falsas acusaciones de acoso sexual, investigaciones inexistentes y consecuencias que nunca ocurrieron, e incluso sugirió que un legislador estadounidense había renunciado en un año en el que ni siquiera estaba en funciones.

Las respuestas de Meta AI variaban según el idioma, la plataforma utilizada y si los usuarios estaban conectados a sus cuentas de Facebook. A pesar de estas variables, la IA producía constantemente historias completamente inventadas que compartían similitudes muy sorprendentes.

La senadora del estado de Nueva York Kristen González y el asambleísta Clyde Vanel, que presiden comités encargados de la legislación estatal relacionada con la IA, fueron dos de los legisladores estadounidenses afectados por las falsas acusaciones de acoso sexual generadas por Meta AI.

González expresó su preocupación por cómo los chatbots de IA pueden difundir desinformación, destacando la necesidad de responsabilizar a empresas como Meta por los textos generados por sus chatbots. Vanel, aunque apoya la tecnología IA, también se mostró preocupado y enfatizó la importancia de abordar estos problemas sin sofocar la innovación.

El estado de Nueva York aprobó recientemente un presupuesto que incluye disposiciones para penalizar el uso engañoso de imágenes y audio “deepfake”, y exige que el material electoral que utilice IA incluya un descargo de responsabilidad. Sin embargo, no aborda específicamente la desinformación generada por herramientas de IA como Meta AI.

Kevin McAlister, portavoz de Meta, defendió la tecnología de la compañía, reconociendo que “la IA puede devolver resultados inexactos o inapropiados”, y prometiendo más actualizaciones y mejoras.