AMD ha presentado su primera serie de grandes modelos de lenguaje (LLM) de 1.000 millones de parámetros y código abierto, denominada AMD OLMo, dirigida a diversas aplicaciones y preentrenada en las GPU Instinct MI250 de la compañía.

Suscríbete a la Newsletter de Softonic y recibe las últimas noticias en tech, juegos, entretenimiento en tu buzón de correo

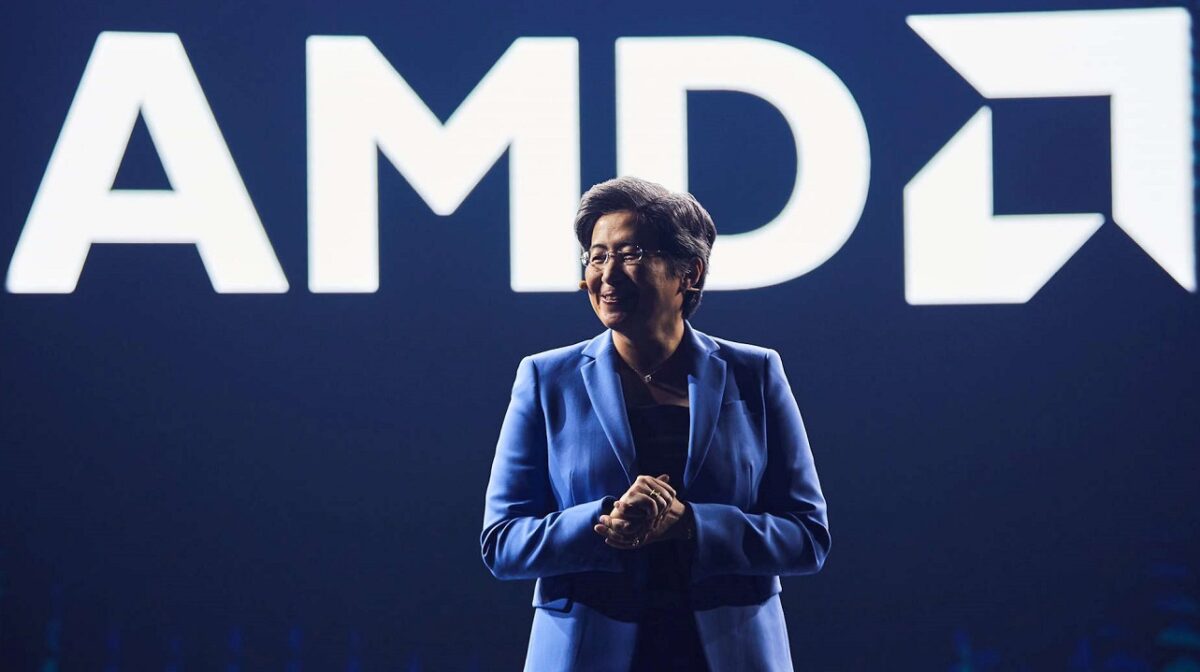

Suscríbete (es GRATIS) ►Los LLM de código abierto de AMD pretenden mejorar la posición de la compañía en la industria de la IA y permitir a sus clientes (y a todo el mundo) implantar estos modelos de código abierto con el hardware de AMD.

Al hacer públicos los datos, los pesos, las recetas de entrenamiento y el código, AMD pretende permitir a los desarrolladores no solo reproducir los modelos, sino también basarse en ellos para seguir innovando.

Más allá del uso en centros de datos, AMD ha permitido el despliegue local de modelos OLMo en PCs AMD Ryzen AI equipados con unidades de procesamiento neural (NPUs), permitiendo a los desarrolladores aprovechar los modelos de IA en dispositivos personales.

Todo lo que sabemos sobre el LLM de AMD

Los modelos AMD OLMo se entrenaron en un amplio conjunto de datos de 1,3 billones de tokens en 16 nodos, cada uno con cuatro GPU AMD Instinct MI250 (64 procesadores en total). La línea de modelos OLMo de AMD se entrenó en tres pasos.

En las propias pruebas de AMD, los modelos OLMo de AMD mostraron un rendimiento impresionante frente a modelos de código abierto de tamaño similar, como TinyLlama-1.1B, MobiLlama-1B y OpenELM-1_1B en pruebas de referencia estándar para capacidades de razonamiento general y comprensión multitarea.

El modelo SFT de dos fases experimentó mejoras significativas en la precisión, con un aumento del 5,09% en las puntuaciones de MMLU y del 15,32% en GSM8k, lo que demuestra el impacto del enfoque de entrenamiento de AMD.

El modelo final AMD OLMo 1B SFT DPO superó a otros modelos de chat de código abierto en al menos un 2,60% de media en las pruebas comparativas.

Además, AMD probó pruebas de IA responsables, como ToxiGen (que mide el lenguaje tóxico, donde una puntuación más baja es mejor), crows_pairs (que evalúa la parcialidad) y TruthfulQA-mc2 (que evalúa la veracidad en las respuestas). Y se comprobó que los modelos OLMo de AMD estaban a la par con modelos similares en el manejo de tareas de IA éticas y responsables.